Domů » Odpovědnost za algoritmy a manipulativní AI: co dnes skutečně hrozí podnikatelům

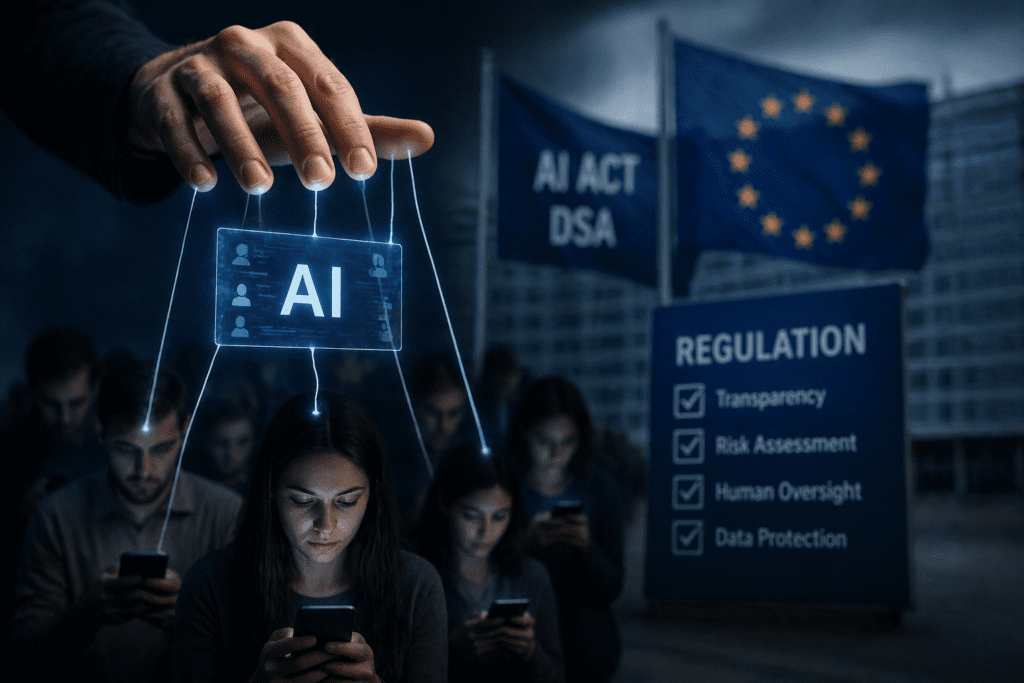

Odpovědnost za algoritmy a manipulativní AI: co dnes skutečně hrozí podnikatelům

Debata o odpovědnosti za algoritmy se často otevírá na příkladech z USA, kde jsou technologické společnosti žalovány až ve chvíli, kdy dojde ke konkrétní újmě. Typicky jde o spory týkající se doporučovacích systémů, závislostního designu nebo vlivu digitálních služeb na psychické zdraví uživatelů.

Evropský přístup je odlišný. Nestaví primárně na následném vymáhání škody, ale na prevenci. Regulace se snaží rizikovému chování předcházet ještě předtím, než vznikne problém.

Pro podnikatele to znamená jediné: odpovědnost za algoritmy se řeší už při jejich návrhu a nasazení, nikoli až ve sporu.

Evropa: regulace místo sporů

Zatímco americký model je postavený na soudních sporech, Evropská unie pracuje s kombinací:

- předběžných pravidel (compliance),

- průběžného dohledu,

- vysokých sankcí za porušení.

Klíčovou roli hrají zejména dva předpisy:

- Akt o digitálních službách (DSA),

- Akt o umělé inteligenci (AI Act).

Každý z nich dopadá na jinou část digitálního prostředí, dohromady však vytvářejí relativně přísný regulační rámec.

Manipulativní design pod drobnohledem (DSA)

DSA se zaměřuje především na fungování online platforem a jejich uživatelská rozhraní.

Jedním z jeho klíčových prvků je zákaz tzv. „temných vzorců“ (dark patterns). Jde o takové nastavení rozhraní, které má uživatele manipulovat nebo ovlivnit jeho rozhodování.

Typicky se jedná například o:

- znevýhodnění možnosti odmítnout cookies,

- nejasné nebo klamavé tlačítko pro zrušení služby,

- automatické přidávání služeb do košíku,

- záměrné komplikování odhlášení nebo ukončení předplatného.

Regulace však nekončí u designu. Velké platformy mají povinnost:

- pravidelně vyhodnocovat systémová rizika,

- provádět nezávislé audity,

- transparentně popisovat fungování svých algoritmů.

To zahrnuje i posouzení dopadů na duševní zdraví uživatelů nebo šíření škodlivého obsahu.

AI Act: kde je hranice zakázaného

Zatímco DSA řeší prostředí, AI Act míří přímo na samotné systémy umělé inteligence.

Zcela zásadní je, že některé praktiky jsou v EU přímo zakázány.

Patří mezi ně zejména:

Podprahové nebo manipulativní techniky. Systémy, které ovlivňují chování uživatele způsobem, který si uživatel neuvědomuje, a které mohou vést k jeho újmě.

Zneužívání zranitelnosti. Algoritmy cílené na osoby ve zranitelném postavení (např. děti, senioři nebo osoby v tíživé situaci), pokud mají manipulativní charakter.

Rozpoznávání emocí v citlivých kontextech. Například na pracovišti nebo ve vzdělávání, pokud má být využito k hodnocení osob.

Sociální scoring. Hodnocení důvěryhodnosti osob na základě jejich chování, pokud vede k nepřiměřenému znevýhodnění.

Klíčové je, že regulace nepostihuje jen vývojáře těchto systémů, ale i jejich nasazení v praxi.

Odpovědnost nekončí u vývojáře

Z pohledu evropského práva není rozhodující, kdo algoritmus vytvořil, ale kdo jej používá.

To znamená, že odpovědnost může dopadat i na:

- provozovatele e-shopu využívajícího doporučovací algoritmy,

- zaměstnavatele nasazujícího AI pro hodnocení zaměstnanců,

- platformy pracující s personalizovaným obsahem.

Jinými slovy: i běžná firma může nést odpovědnost za to, jak algoritmus ovlivňuje chování jejích uživatelů.

Dohled a sankce

V České republice vykonává dohled více orgánů v závislosti na konkrétní oblasti:

- Český telekomunikační úřad (DSA),

- vícero dozorových orgánů nad trhem (AI Act),

- Úřad pro ochranu osobních údajů (GDPR).

Tyto orgány mají rozsáhlé pravomoci, včetně možnosti:

- požadovat dokumentaci a interní analýzy,

- kontrolovat fungování systémů,

- nařizovat nápravná opatření.

Sankce mohou dosahovat až:

- 6 % celosvětového obratu (DSA),

- 7 % celosvětového obratu nebo desítek milionů eur (AI Act).

Co to znamená pro vaši společnost?

Regulace umělé inteligence se netýká jen technologických gigantů. Dopadá i na podnikatele, kteří:

- provozují e-shop nebo online platformu,

- pracují s personalizací obsahu,

- využívají automatizované rozhodování,

- zavádějí AI nástroje do interních procesů.

Zásadní otázka dnes nezní, zda AI používáte, ale jakým způsobem ovlivňuje chování vašich uživatelů nebo zaměstnanců.

Závěr

Evropský přístup k umělé inteligenci stojí na prevenci. Nečeká se na vznik škody, ale reguluje se už samotný návrh a fungování systémů.

Pro podnikatele to znamená posun v odpovědnosti: nejen za to, co jejich produkty dělají, ale i za to, jak ovlivňují rozhodování lidí.

Pokud využíváte algoritmy nebo zvažujete jejich nasazení, je vhodné tuto oblast řešit včas. Správně nastavený systém vám může ušetřit nejen regulatorní rizika, ale i reputační dopady.

V ASPIDOS vám pomůžeme identifikovat rizika a nastavit řešení, které bude odpovídat evropským pravidlům i vaší obchodní realitě.

ASPIDOS advokátní kancelář s.r.o.

Petr Prucek, paralegal

Mgr. Alexandr Liolias, advokát, partner